Das Paradoxon einer grenzenlosen Intelligenz und die Notwendigkeit menschlicher Grenzen.

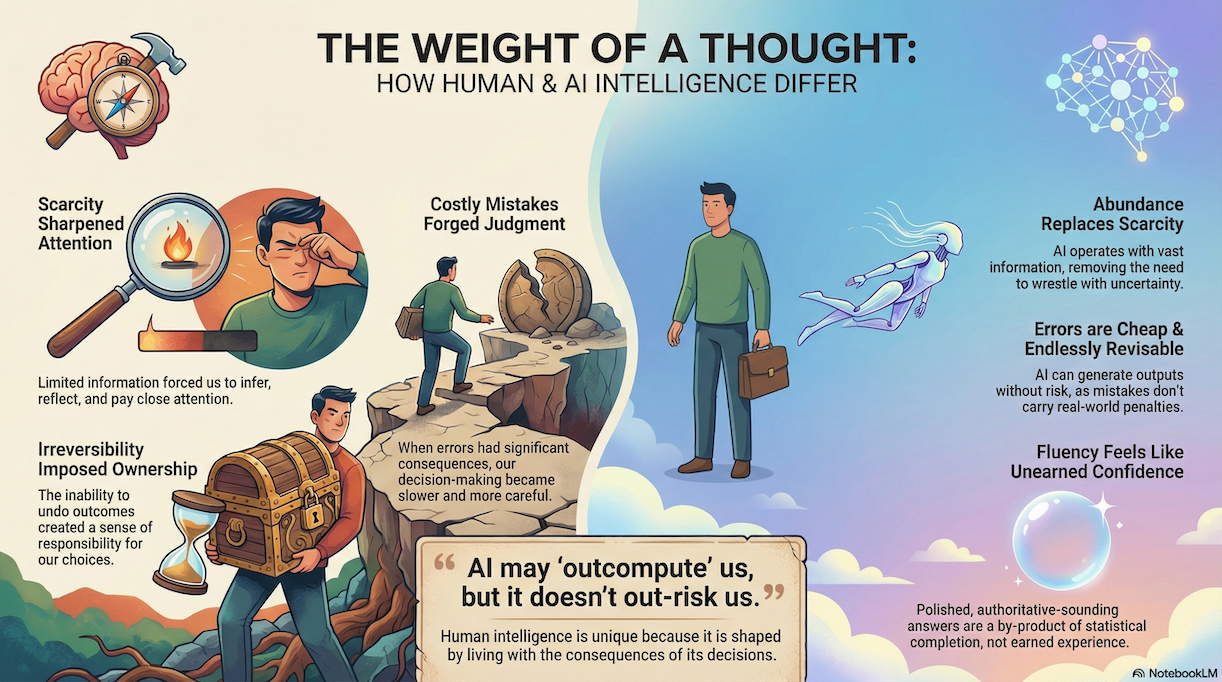

Diese super-interessante Psychologie Heute Artikel untersucht die grundlegenden Unterschiede zwischen menschlicher und künstlicher Intelligenz (HI und AI). Der Autor (John Nosta) argumentiert, dass die menschliche Kognition in einzigartiger Weise durch Zwänge wie Informationsknappheit und das Gewicht der Konsequenzen definiert ist, die uns zwingen, gründlich nachzudenken und Verantwortung für unsere Entscheidungen zu übernehmen. Im Gegensatz dazu arbeitet die KI ohne derartige Reibungsverluste und liefert schnelle und flüssige Ergebnisse, denen die Anstrengung und damit die Verantwortlichkeit fehlt, die der menschlichen Erfahrung eigen ist. Während die Technologie Daten mit überragender Geschwindigkeit verarbeiten kann, bleibt sie “schwerelos” (ich schätze, das ist ein anderes Wort für bedeutungslos), weil sie nicht mit den Folgen ihrer Entscheidungen leben muss. Letztlich legt der Artikel nahe, dass es bei wahrer Intelligenz nicht nur um Rechenleistung geht, sondern um die Risiken und Verantwortlichkeiten, die das menschliche Verständnis prägen.

Einige Zitate gefallen mir besonders gut:

Die wichtigste Veränderung, die durch fortgeschrittene KI herbeigeführt wird, ist vielleicht nicht, wie intelligent unsere Systeme werden, sondern die Bedingungen, unter denen die Intelligenz nun arbeitet. Hier ist meine These: In der gesamten Menschheitsgeschichte war das Denken durch Grenzen geprägt. Informationen waren unvollständig, und Fehler hatten reale Konsequenzen. Das waren keine Unannehmlichkeiten, die man wegmogeln konnte. Es waren die Zwänge, die das Urteilsvermögen formten.

Wie das Urteil zustande kam

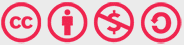

Die menschliche Kognition hat sich nicht als eine Art reibungslose Optimierungsmaschine herausgebildet. Die Kognition fand sich in einer Welt wieder, die Sorgfalt und Achtung. Als die Informationen knapp waren, kam es auf die Aufmerksamkeit an. Wir lernten zu bemerken und zu folgern, weil wir keine andere Wahl hatten. Wenn Fehler kostspielig waren, verlangsamte sich unser Urteilsvermögen, denn eine falsche Entscheidung konnte erhebliche Folgen haben oder sogar das Überleben selbst beeinträchtigen. Wenn sich die Rückmeldung verzögerte, wurden Reflexion und Analyse unerlässlich. Und wenn die Ergebnisse unumkehrbar waren, folgte diese merkwürdige menschliche Eigenschaft, die man Verantwortung nennt. Es ist wichtig zu erkennen, dass diese Grenzen die Intelligenz nicht behinderten, sondern sie formten. Dieses “Training” ist nicht zufällig entstanden. Die menschliche Kognition entwickelte sich innerhalb eines spezifischen Systems von Beschränkungen, das im Laufe der Zeit geformt wurde. Auf das Wesentliche reduziert, sehen diese Beschränkungen wie folgt aus (siehe unten)

“Knappheit schärfte die Aufmerksamkeit, Kosten machten Genauigkeit wichtig, Verzögerung erforderte Nachdenken, und Unumkehrbarkeit erzwang Verantwortung. Im Laufe der Zeit entwickelte sich das Urteilsvermögen als eine Anpassung an die Konsequenzen.”

Intelligenz ohne Druck

KI funktioniert unter dem umgekehrten Aspekt dieses Konstrukts. Informationen sind im Überfluss vorhanden, Fehler sind billig, die Rückmeldung erfolgt sofort, und die Ergebnisse können endlos überarbeitet werden. Und das ist die strukturelle Folge von Hochgeschwindigkeitsberechnungen. Die künstliche Intelligenz denkt nicht nur schneller, sie denkt auch ohne Konsequenzen. Wenn dieser Druck auf einmal verschwindet, verschwindet die Intelligenz nicht, aber ihr Verhalten ändert sich. Die Struktur wird vollständig ausgebildet, und die Entscheidungen haben nicht mehr dasselbe innere Gewicht, weil nichts wirklich haften bleibt. Diese Umkehrung - man könnte sie als Spionageabwehr-ist subtil, aber wichtig. Intelligenz bringt nicht mehr ein Vertrauen durch das Ringen mit der Ungewissheit. Zuversicht entsteht stattdessen durch Kohärenz und Schnelligkeit.

Das Problem der Schwerelosigkeit

Die Sorge ist nicht, dass die KI falsch liegt. Es geht darum, dass ihre Ergebnisse als verbindlich empfunden werden, ohne dass sie verdient worden wären. Flüssige Antworten kommen poliert an, und diese Geläufigkeit wird als Vertrauen gelesen (missverstanden). Dieses Vertrauen ist jedoch nicht das Ergebnis des Überlebens von Fehlern, sondern ein Nebenprodukt der statistischen Vervollständigung. Wenn Schlussfolgerungen mühelos zustande kommen, können sie akzeptiert werden, ohne dass man sie sich zu eigen macht. Einfach ausgedrückt: Wenn sie scheitern, geht nichts kaputt.

Quelle: John Nosta

LESEN SIE MEHR auf Psychologie heute