Porque temos de agir agora para garantir que o progresso tecnológico exponencial continue a ser um benefício para a humanidade e para o planeta. ENGLISH version here.

Gerd Leonhard, Futurista e Humanista. Zurich, Switzerland May 17 2021. Versão em Inglês publicada também na Cognitive World.

A tecnologia tem sido, sem dúvida, boa para nós. Os sistemas de IA são agora capazes de detectar algumas formas de cancro de pele com uma maior taxa de exactidão do que os médicos humanos. Os robôs realizam exames de ultra-som e cirurgia, por vezes com pouca ou nenhuma intervenção humana. Os pilotos automáticos voam e aterram aviões nas condições mais adversas e podem em breve ser capazes de pilotar táxis aéreos pessoais. Os sensores recolhem dados ao vivo de máquinas e dos seus “gémeos digitais” para prever falhas futuras ou avisar de reparações cruciais. As impressoras 3D são capazes de cuspir peças sobressalentes, melhorando as opções de manutenção em locais remotos.

No entanto, à medida que a tecnologia e os sistemas de IA em particular se tornam cada vez mais poderosos, a desvantagem de acelerar exponencialmente o progresso tecnológico também entra em grande foco. Contextualizando Marshall McLuhan (57 anos atrás!), cada vez que alargamos as nossas capacidades, também amputamos outras. Hoje, os meios de comunicação social prometem “alargar-nos”, permitindo que todos nós partilhemos os nossos pensamentos online, mas também nos “amputam”, tornando-nos alvos fáceis de localização e manipulação. Ganhamos o alcance, mas perdemos a privacidade.

O impacto da mudança exponencial é incrivelmente difícil de imaginar

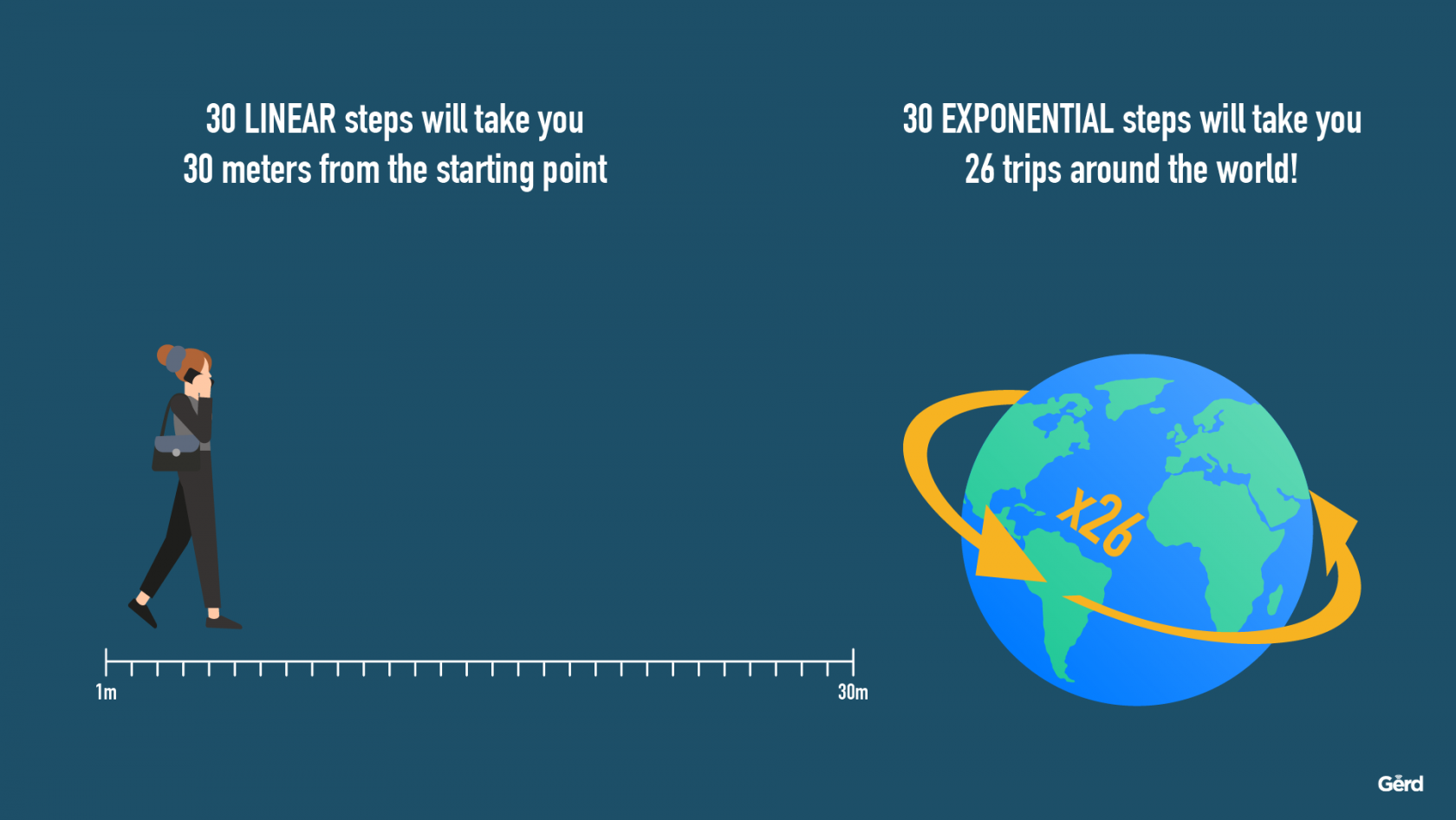

Devemos ter em conta que embora o progresso tecnológico de hoje pareça frequentemente muito impressionante e útil, na sua maioria inofensivo e facilmente controlável, seria de facto muito tolo assumir que isto permanecerá o mesmo num futuro próximo, pois estamos literalmente a saltar a curva exponencial de 4 para 8 para 16 e assim por diante. 30 passos linearmente podem levar-me a atravessar a rua, 30 passos exponenciais equivalem a 26 viagens à volta do globo. O alcance da magnitude é totalmente diferente e o que quer que tenha funcionado antes do ponto pivot pode revelar-se desastroso mais tarde.

Aqui mesmo, neste momento, estamos no ponto de descolagem de muitas das ciências e tecnologias fundamentais do século XXI, desde a inteligência artificial e aprendizagem profunda até à edição do genoma humano, passando pela geo-engenharia, longevidade e aperfeiçoamento humano – toda a nossa estrutura está prestes a mudar – e não apenas a imagem!

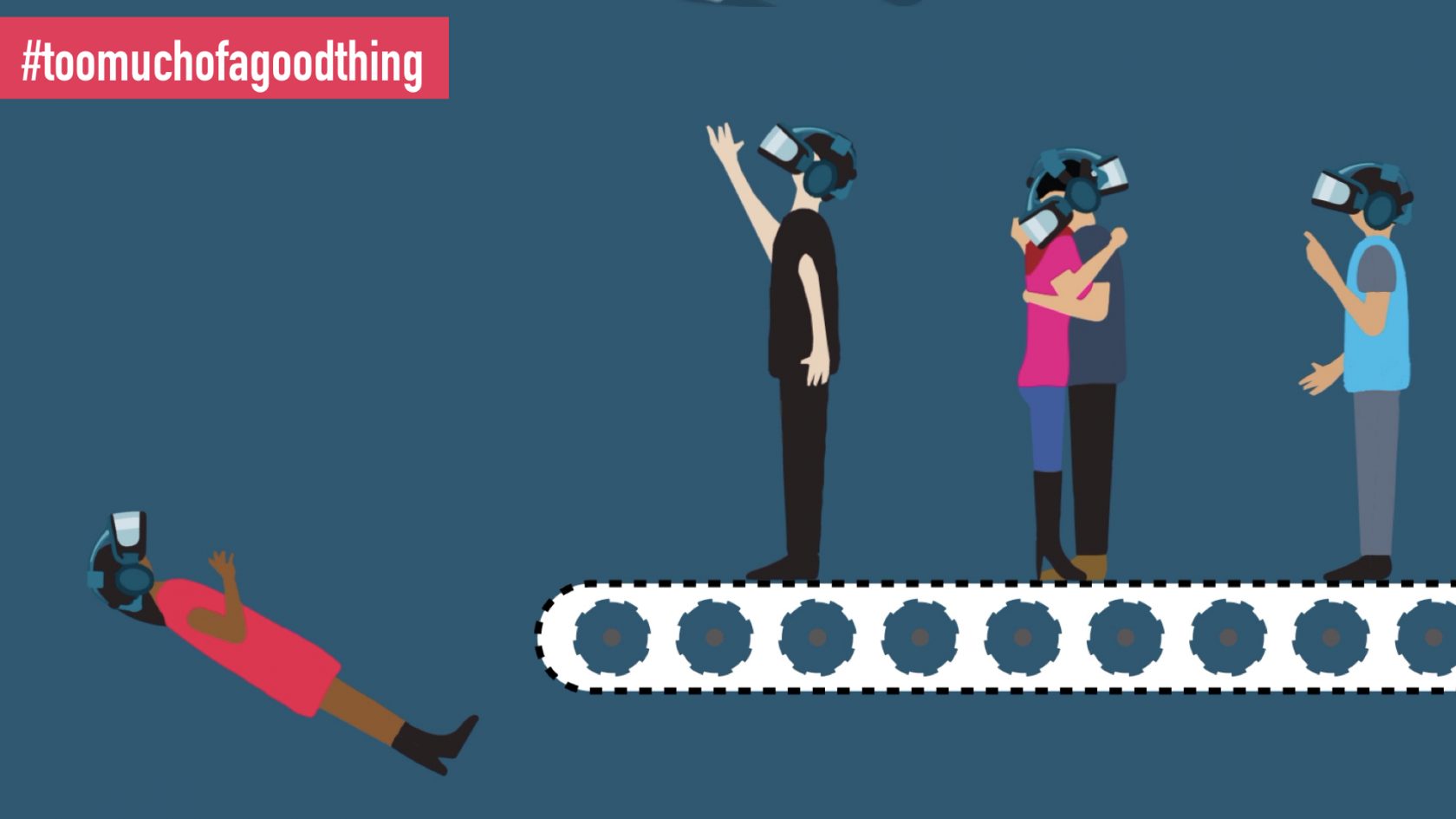

Durante a próxima década, cada um dos domínios acima mencionados (aquilo a que muitas vezes chamo de Game-Changers) tem mais mudanças previstas do que assistimos em todo o século anterior, no total. A ficção científica está a tornar-se cada vez mais um facto científico – e como os humanos são biológicos (por agora) e não progridem exponencialmente, temos muitas vezes muita dificuldade em compreender para onde tudo isto vai. O que pode ser realmente espantoso, mágico e “bom” para nós hoje em dia, pode em breve tornar-se “demasiado bom”, e passar de ser uma ferramenta a ser o propósito, de ser uma dádiva de Deus a ser uma máquina do juízo final.

Quer se trate de melhorar o ser humano, de conceber quimeras ou robôs que vão para a guerra: O que irá acontecer durante os próximos 10 anos irá varrer a maioria das nossas noções sobre o progresso gradual e elevar a nossa visão sobre como a inovação tecnológica normalmente e talvez até inadvertidamente promove o bem comum.

Definindo ‘O Bom Futuro'

Na minha opinião, aquilo a que recentemente comecei a chamar “o bom futuro” (ou seja, uma utopia ou melhor ainda uma protopia em oposição a uma distopia) está agora em jogo, e não nos podemos dar ao luxo de nos afastarmos do trabalho árduo, como definir colectivamente o que um “bom futuro” significa realmente para nós, colectivamente e como espécie, e como podemos melhor moldá-lo, juntos. Por mais árduo que possa parecer um consenso sobre a questão do “bom”, o futuro deve ser criado colectivamente ou não haverá nenhum – pelo menos não um que nos envolva a nós humanos (ver o tratado nuclear / analogias do TNP abaixo).

Neste momento, como vemos alguma semelhança de luz no fim do túnel pandémico, é um bom momento para iniciar uma discussão honesta e aberta sobre os nossos objectivos comuns e os nossos telos (ou seja, o objectivo), e sobre as políticas de que precisaremos para criar esse “Bom Futuro”. Uma coisa é certa: A doutrina do mercado livre falhou-nos recentemente pelo menos duas vezes (durante a crise financeira de 2007, e durante a crise da Covid), e o papel do governo como agente de mercado deverá ser muito mais proeminente na próxima década. Não é provável que o Bom Futuro venha a surgir com um bom capitalismo à moda antiga, e também não será introduzido pela tecnologia. Pelo contrário, é uma questão de ética, valores – e as políticas que elaboramos com base neles.

Está na hora de Rehumanizar!

Agora é tempo de pensar e agir em “civilizar” ou “re-humanizar” e sim, regular (mas não estrangular) os gigantes globais da tecnologia – porque nesta era de mudança exponencial avançada, as incríveis descobertas de hoje podem muito bem vir a revelar-se grandes problemas não muito longe. O que parece estar bem em “1” pode já não estar bem quando atingimos “16” na curva exponencial (ou seja, após 5 duplicações). Precisamos urgentemente de olhar muito mais à frente à medida que avançamos para o futuro a uma velocidade vertiginosa. Previsão é simplesmente uma missão crítica agora e não apenas “agradável de se ter”. “O Futuro” está a tornar-se um ponto da agenda diária para cada líder e funcionário público.

Portanto, vamos parar de perguntar “o que trará o futuro” – pode em breve, muito literalmente, trazer quase tudo o que possamos imaginar. Em vez disso, precisamos de perguntar: “que tipo de futuro queremos?

O espantoso feito de desenvolver não apenas uma mas várias vacinas eficazes contra a SRA-CoV-2 é um caso exemplar no que diz respeito ao nosso estado exponencial acelerado. O que costumava demorar uma década e mais, agora demorou apenas 12 meses, graças em grande parte às capacidades globais da computação na Cloud e da IA. Dentro de uma década, é provável que esse ciclo de desenvolvimento se reduza para seis semanas ou menos. Imaginem só.

Contudo, esta realização não deve desviar a verdade básica de que a tecnologia tem sempre usos duplos; pode ser boa e não tão boa ao mesmo tempo: É “moralmente neutra até a utilizarmos” (W. Gibson). “Demasiado bom” descreve muito bem este enigma: algo bastante útil pode rapidamente tornar-se algo profundamente prejudicial e corrosivo para a sociedade – como recentemente evidenciado nos meios de comunicação social, que sofrem de obsessão de monetização excessiva e de total falta de responsabilização.

É por isso que eu penso que a Comissão Europeia está no bom caminho com os seus recentes esforços de regulamentação da IA e da tecnologia. Sim, é complicado, é doloroso e pode, por vezes, ser demasiado tolerante – mas, de alguma forma, temos de começar a olhar para além dos factores económicos e do crescimento a todo o custo, e avançar para aquilo a que tenho vindo a chamar o quádruplo resultado de “pessoas, planeta, propósito e prosperidade” (alargando o trabalho feito por Elkington e outros no triplo resultado).

“Demasiadas coisas boas” – soa familiar?

Não é uma coincidência que o uso excessivo e a dependência de dispositivos e serviços online sejam frequentemente considerados um vício. Muitos de nós usamos drogas sob alguma forma, desde o álcool e o tabaco até substâncias controladas. As sociedades aprenderam a lidar com esses vícios através de leis, regulamentos e uma série de contratos sociais destinados a limitar o seu alcance e impacto negativo. A tecnologia não é diferente na medida em que o uso excessivo ou a sobre-exposição também arruina vidas. Muitos estudos têm documentado que os utilizadores de poder das redes sociais estão frequentemente no topo das listas propensas ao suicídio, e que o FOMO (longe de perder algo) pode levar a graves distúrbios de ansiedade. Mas basta esperar até termos 5G e aplicações de realidade virtual generalizadas e “óculos inteligentes”.

Há um perigo palpável de que este progresso tecnológico rápido e saltitante possa não ser governado sabiamente antes que as suas capacidades em constante expansão nos dominem, e nos apresente um futuro de facto que a maioria de nós não desejaria para os seus filhos. Precisamos, portanto, de uma mistura de “novas normas” e contratos sociais, responsabilidade demonstrada e responsabilização nos negócios e na indústria, e salvaguardas reais tais como regulamentação, leis e tratados. A nossa resposta deve ser ampla e flexível, justa e democrática, mas decisiva quando se trata de agir pelo lado da precaução.

Imagine, por exemplo, o que se tornará em breve possível quando a maioria de nós tiver os nossos dados de saúde armazenados na Cloud e interagir regularmente com assistentes digitais e chatbots para coisas como o apoio à saúde mental. A reunião de grandes conjuntos de dados derivados do genoma humano, bioma e de observações comportamentais (por exemplo, quando se utiliza um dispositivo móvel ou um relógio inteligente ou quando se usa um conjunto VR) pode dar-nos ferramentas para detectar doenças degenerativas e possivelmente até pré-diagnóstico de cancro. No entanto, as consequências das violações da privacidade neste domínio podem também ser mil vezes piores do que as armadilhas actuais, por exemplo, quando os dados de localização das pessoas são capturados ilicitamente. Mais uma vez, como diz a canção: “Ainda não se viu nada“.

A regulação e o desafio de um consenso global: a analogia nuclear

Existe um exemplo útil na forma como lidámos com a ameaça de proliferação nuclear. Infelizmente, foram precisas duas bombas nucleares e quase 25 anos de trabalho árduo antes que o TNP global entrasse em vigor em 1970. Hoje em dia, dada a rapidez e amplitude do avanço da tecnologia, não teremos mais o luxo de uma pista tão longa – e é muito mais difícil construir uma bomba nuclear do que escrever em código. Ou – tendo uma visão mais fraca – poderá ser que, num futuro não muito distante, tenhamos de experimentar primeiro incidentes catastróficos causados por uma dependência excessiva de “máquinas inteligentes” inaptas e inseguras, ou enfrentar ainda mais o colapso do ecossistema devido a experiências precipitadas com a geo-engenharia?

A nível local, nacional, regional e inevitavelmente a uma escala global, precisamos de chegar a acordo sobre as linhas de fundo do que podemos acordar, e estabelecer limiares realistas de “menor denominador comum” para além dos quais certas aplicações tecnológicas não podem ser prosseguidas apenas “porque podemos” ou porque podem ser alcançáveis enormes benefícios económicos. Um desses exemplos de consenso alcançável é a proibição de sistemas de armas autónomos que matam sem supervisão humana, ou a proibição do uso do reconhecimento facial que, mais recentemente, afectam o reconhecimento para fins comerciais duvidosos. Trata-se de outra questão que a Comissão da UE começou a abordar.

A única questão que realmente importa: Que tipo de mundo queremos deixar aos nossos filhos?

Temos de perceber que dentro desta próxima década já não se trata do futuro que podemos construir, mas sim do futuro que queremos construir. Já não se tratará apenas de grande engenharia ou de economia inteligente, mas sim de valores, ética e propósito. As limitações científicas e tecnológicas continuarão a cair a um ritmo acelerado, enquanto as implicações éticas e societais se tornarão no verdadeiro ponto focal. Como disse o famoso E.O. Wilson: “O verdadeiro problema da humanidade é o seguinte: temos emoções paleolíticas; instituições medievais; e tecnologia semelhante a Deus”.

Para além disto, Winston Churchill proclamou: “Pode sempre contar com os americanos para fazer a coisa certa – depois de terem tentado tudo o resto“, e eu adapto frequentemente esta citação para ler “humanos” em vez de americanos. Mas haverá inevitavelmente coisas que nunca devem ser tentadas porque podem ter consequências irreversíveis e existenciais para os seres humanos e para o nosso planeta, e essa lista está a tornar-se cada dia mais longa. A começar pela busca de inteligência geral artificial, geo-engenharia e edição do genoma humano – todas estas tecnologias podem potencialmente ser o paraíso, ou podem ser o inferno. E quem será o “controle de missão” para a humanidade?

Em particular, a abordagem bem documentada de Silicon Valley para experimentar quase tudo e pedir autorização mais tarde (“Avance rápido e quebre coisas”, na linguagem pré-IPO de Zuckerberg) vai levar-nos por um caminho muito perigoso. Esta noção pode ter sido tolerável ou mesmo excitante no início da curva exponencial (onde parece quase o mesmo que uma curva linear), mas avançar com este paradigma é decididamente inadequado para ajudar a trazer “o bom futuro”. Pedir perdão simplesmente não funciona quando a tecnologia pode trazer rapidamente ameaças existenciais que podem estar muito além do desafio que enfrentamos com armas nucleares.

Levar a ideia a fazer os humanos “sobre-humanos” de alguma forma, perseguindo longevidade extrema ou ligando os nossos cérebros à Internet (sim, Elon Musk parece clamar para se tornar o principal fornecedor destas ideias). Receio que corramos o risco de acabar com soluções mal cozinhadas introduzidas por corporações com fins lucrativos enquanto o público tem de apanhar as peças e reparar as externalidades – tudo em nome do progresso.

Estamos numa encruzilhada na estrada: O futuro é a nossa escolha, por acção ou por inacção

O tempo é essencial. Temos dez curtos anos para debater, acordar e implementar novos quadros e regras globais (ou pelo menos territoriais) no que diz respeito à governação de tecnologias exponenciais.

Se não chegarmos a acordo sobre pelo menos os menores denominadores comuns (tais como proibições claras de sistemas de armas autónomas letais, ou proibições de utilização da engenharia genética humana para fins militares) preocupa-me que as externalidades do crescimento tecnológico desenfreado e não supervisionado da IA, da edição do genoma humano e da geo-engenharia se revelem tão prejudiciais como as que foram criadas pelo crescimento quase irrestrito da economia dos combustíveis fósseis. Em vez da mudança climática, será a “mudança humana” que nos colocará desafios muito perversos se não aplicarmos aqui mais algum “pensamento de precaução“.

No futuro, ninguém deverá ser autorizado a terceirizar as externalidades negativas do seu negócio, seja em energia, publicidade, pesquisa, meios de comunicação social, computação na Cloud, a Internet, IA ou com Realidade Virtual.

Quando uma empresa como a Alphabet's Google quer transformar um bairro inteiro de Toronto no seu laboratório inteligente da cidade (Side Walks Lab), é o negócio inicial – não a comunidade e a sociedade civil – que tem de ser responsabilizado pelas mudanças societais que se seguem que a conectividade e o rastreio generalizados provocam – tanto boas como más. Empresas como a Google têm de perceber que nesta era exponencial (ou seja, “para além do ponto pivot“) são de facto responsáveis pelo que inventam e pela forma como o implementam. Todas as questões tecnológicas são agora também uma questão ética, e o sucesso na tecnologia já não se trata apenas de “grande ciência, engenharia espantosa e modelos de negócio escaláveis” (e talvez nunca tenha sido).

Em vez disso, as responsabilidades de lidar com as desvantagens potencialmente graves (e cada vez mais existenciais) têm de ser enraizadas em cada modelo de negócio, desde o início, e devem ser considerados todos os possíveis efeitos secundários durante todo o processo de concepção do negócio e todas as fases subsequentes de implementação. Precisamos de descartar o “jantar primeiro, depois a moral” – doutrina de Silicon Valley ou seus equivalentes Chineses. As abordagens holísticas (isto é, modelos que beneficiam a sociedade, a indústria, os negócios e a humanidade em geral) devem substituir as atitudes de “avançar depressa e quebrar as coisas“, e a lógica das partes interessadas deve substituir a primazia do accionista (*assistir Paul Polman, antigo CEO da Unilever, falar sobre isto, aqui)

Nos próximos cinco anos, penso que vamos assistir ao aparecimento de novas bolsas de valores (como a ainda incipiente LTSE em São Francisco) onde serão cotadas empresas que operam com base na premissa “Pessoas, Planeta, Propósito e Prosperidade”. A EUROPA deve agarrar esta oportunidade e assumir a liderança!

Chamem-me optimista ou utópico, mas estou convencido de que ainda podemos definir e moldar um “bom futuro” para toda a humanidade, bem como para o nosso planeta.

Aqui estão algumas sugestões para orientar este debate:

- As questões éticas das tecnologias exponenciais devem ser consideradas tão importantes como os ganhos económicos que elas podem gerar. A tecnologia não é a resposta para todos os problemas, e seria imprudente procurar a tecnologia para “resolver tudo”. Se há uma coisa que aprendi nos meus 20 anos como Futurista, é a seguinte: A tecnologia não resolverá problemas sociais, culturais ou humanos, tais como (in)igualdade ou injustiça. Pelo contrário, muitas vezes piora a situação porque a tecnologia conduz à eficiência independentemente das suas consequências morais. O Facebook é o melhor exemplo para este efeito: um conceito realmente poderoso, muito engenhoso, que funciona incrivelmente bem (tal como concebido) – e no entanto profundamente corrosivo para a nossa sociedade (veja as minhas conversas sobre este tópico, aqui). O CEO da Apple, Tim Cook, acerta em cheio quando diz: “A tecnologia pode fazer grandes coisas, mas não quer fazer grandes coisas. Não quer fazer nada“. O “quer” é o nosso trabalho, e não devemos fugir a essa responsabilidade só porque é enfadonho ou pode abrandar a monetização.

- Os seres humanos devem permanecer no topo (HITL): Num futuro previsível, e até que estejamos muito mais longe na compreensão de nós próprios (e não apenas do nosso cérebro) e capazes de controlar as tecnologias que poderiam potencialmente “ser como nós” (como IAG ou IAS), acredito firmemente que precisamos de manter os humanos no circuito, mesmo que seja menos eficiente, mais lento ou mais dispendioso. Caso contrário, podemos estar no caminho da desumanização muito mais depressa do que pensamos. A pró-acção e a precaução devem ser cuidadosamente consideradas e constantemente equilibradas.

- Temos de proibir o pensamento a curto prazo e habituarmo-nos a ter uma visão tanto exponencial como a longo prazo – respeitando ao mesmo tempo o facto de os humanos serem orgânicos (ou seja, o oposto de exponencial). Como mencionado acima, estamos agora mesmo a atravessar aquela linha mágica em que o ritmo dos foguetes de mudança se eleva: 1-2-3 pode parecer-se muito com 1-2-4, mas saltar de 4 para 8 para 16 é muito diferente de ir de 3 para 4 para 5. Temos de aprender e praticar como viver linearmente, mas imagine exponencialmente; uma perna no presente e uma perna no futuro.

- Precisamos de novos “tratados de não-proliferação”. Inteligência artificial geral (IAG), geo-engenharia ou edição do genoma humano são tanto oportunidades mágicas como ameaças existenciais significativas (tal como a energia nuclear, alguns argumentariam), mas provavelmente não teremos o luxo de brincarmos com a IAG e depois recuperarmos do fracasso. Uma “explosão de inteligência” na IA pode muito bem ser um evento irreversível, e o mesmo pode acontecer com as modificações do genoma humano na linha germinal. Por conseguinte, precisaremos de normas prospectivas, vinculativas e colectivas, começando com um memorando internacional sobre a IAG.

- Tenho falado muito sobre a necessidade de um “Conselho de Ética Digital” durante os últimos cinco anos, a começar pelo meu livro de 2016 “Tecnologia vs Humanidade”. Muitos países, estados e cidades começaram recentemente a criar organismos semelhantes, tais como o Conselho Europeu de Inteligência Artificial da UE. Precisamos de mais destes, a nível regional, nacional, internacional, e global!

Por isso, aqui estamos nós em 2021, nesta fatídica e também muito esperançosa encruzilhada no caminho. Cabe a todos nós escolher o caminho certo e começar a construir o “bom futuro”.

Não é demasiado tarde – tenham esperança, tenham coragem e persigam a sabedoria!