Warum wir jetzt handeln müssen, um sicherzustellen, dass der exponentielle technologische Fortschritt ein Gewinn für die Menschheit und den Planeten bleibt. (go to ENGLISH VERSION)

Gerd Leonhard, Futurist & Humanist. Zürich, Schweiz 17. Mai 2021. Auch veröffentlicht auf Cognitive World.

Technologie ist zweifellos gut zu uns gewesen. KI-Systeme sind heute in der Lage, einige Formen von Hautkrebs mit einer höheren Genauigkeit zu erkennen als menschliche Ärzte. Roboter führen Ultraschall-untersuchungen und Operationen durch, manchmal mit wenig bis gar keinem menschlichen Eingriff. Autopiloten fliegen und landen Flugzeuge unter widrigsten Bedingungen und können vielleicht bald auch persönliche Lufttaxis steuern. Sensoren sammeln Live-Daten von Maschinen und ihren “digitalen Zwillingen”, um bevorstehende Ausfälle vorherzusagen oder vor wichtigen Reparaturen zu warnen. 3D-Drucker sind in der Lage, Ersatzteile auszuspucken und verbessern so die Wartungsmöglichkeiten an entlegenen Orten.

Doch mit der zunehmenden Leistungsfähigkeit der Technik und insbesondere der KI-Systeme rückt auch die Kehrseite des exponentiell beschleunigten technischen Fortschritts in den Fokus. In Anlehnung an Marshall McLuhan (vor 57 Jahren!): Jedes Mal, wenn wir unsere Möglichkeiten erweitern, amputieren wir auch andere. Heute versprechen die sozialen Medien, uns zu “erweitern”, indem sie uns allen erlauben, unsere Gedanken online zu teilen, doch sie “amputieren” uns auch, indem sie uns zu leichten Zielen für Verfolgung und Manipulation machen. Wir gewinnen die Reichweite, aber wir verlieren die Privatsphäre.

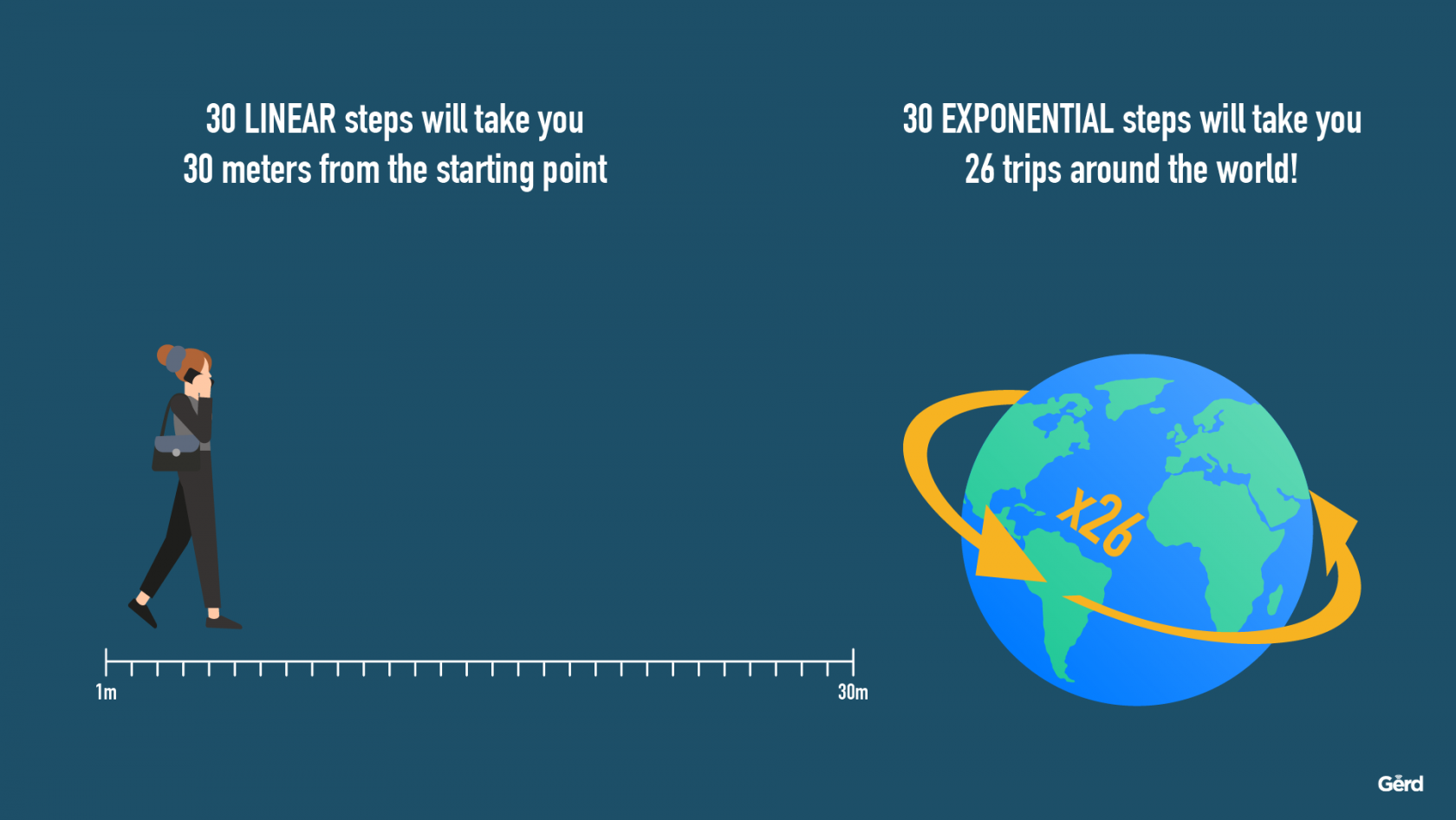

Die Auswirkungen des exponentiellen Wandels sind unglaublich schwer vorstellbar

Wir sollten realisieren dass der heutige technologische Fortschritt zwar oft sehr beeindruckend und nützlich, meist harmlos und leicht kontrollierbar erscheint, es aber sehr töricht wäre, anzunehmen, dass dies in naher Zukunft so bleiben wird, da wir buchstäblich die Exponentialkurve von 4 auf 8 auf 16 und weiter hochspringen. 30 Schritte linear mögen mich über die Straße bringen, 30 exponentielle Schritte entsprechen 26 Reisen um den Globus. Die Größenordnung ist völlig anders und was vor dem Take-Off-Punkt noch irgendwie funktioniert hat, kann sich später als katastrophal erweisen.

Genau hier und jetzt befinden wir uns am Startpunkt für viele der grundlegenden Wissenschaften und Technologien des 21. Jahrhunderts, von künstlicher Intelligenz und Deep Learning über die Bearbeitung des menschlichen Genoms bis hin zu Geo-Engineering, Langlebigkeit und Human Enhancement – unsere gesamten Rahmenbedingungen werden sich ändern – nicht nur das Bild!

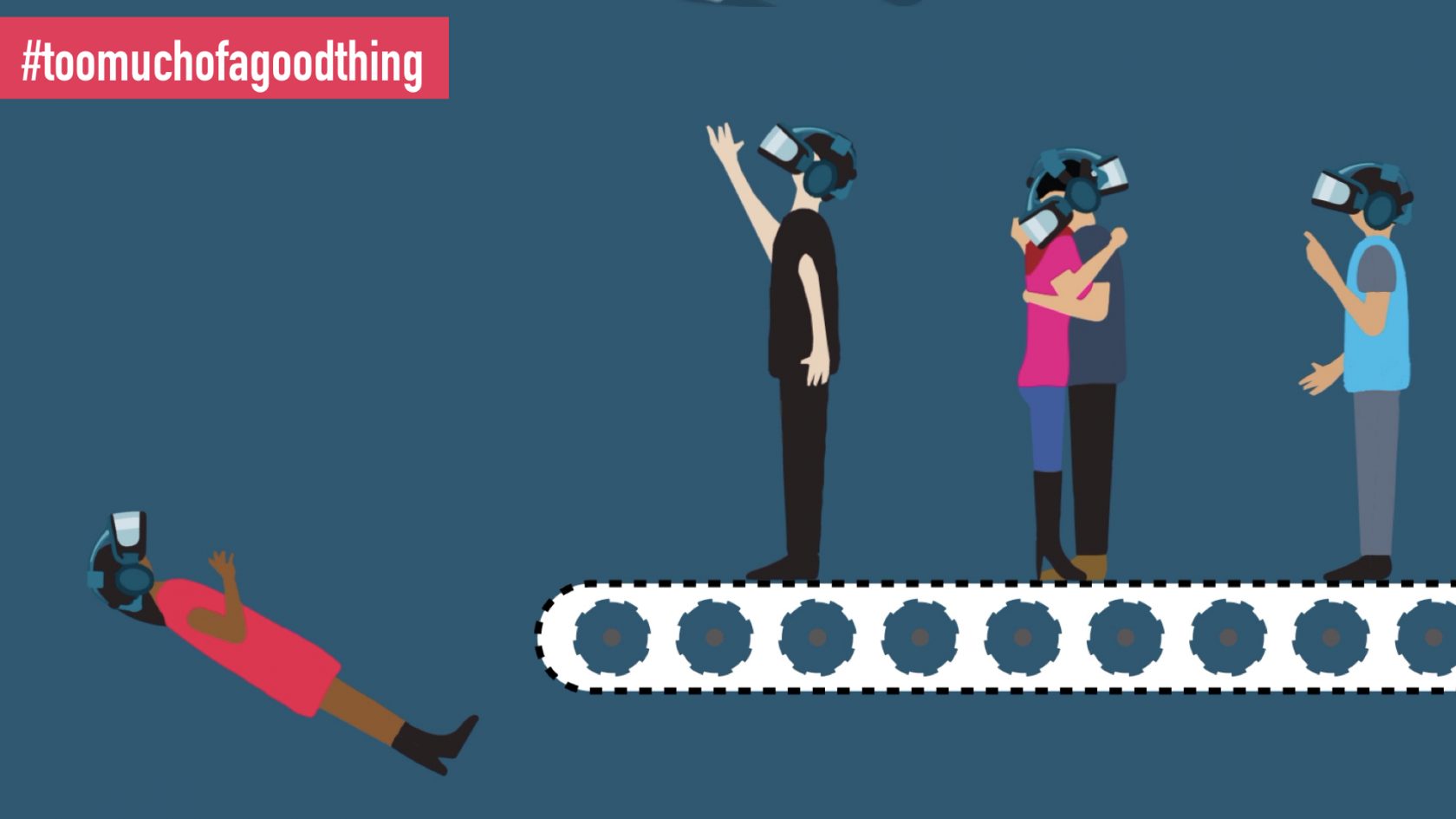

Im nächsten Jahrzehnt wird sich in jedem einzelnen der oben genannten Bereiche (die ich oft als Game-Changers bezeichne) mehr verändern als im gesamten letzten Jahrhundert. Science-Fiction wird zunehmend zu Science-Fakt; und da der Mensch (vorerst noch) biologisch ist und sich nicht exponentiell weiterentwickelt, fällt es uns oft sehr schwer zu verstehen, wohin das alles führt. Was heute noch wirklich erstaunlich, magisch und “gut” für uns ist, kann schon bald “zu viel des Guten” sein und von einem Werkzeug zum Zweck, von einem Gottesgeschenk zu einer Weltuntergangs-Maschine werden.

Ob es darum geht, Menschen zu verbessern, Chimären zu entwerfen oder Roboter in den Krieg zu schicken: Was in den nächsten 10 Jahren passieren wird, wird die meisten unserer Vorstellungen von allmählichem Fortschritt hinwegfegen und unsere Ansichten darüber, wie technologische Innovation normalerweise und vielleicht sogar ungewollt das Gemeinwohl fördert, auf den Kopf stellen.

Die “gute Zukunft” definieren

Meiner Meinung nach steht jetzt das auf dem Spiel, was ich seit kurzem “die gute Zukunft” also “The good Future” nenne (d.h. eine Utopie oder besser noch eine Protopie im Gegensatz zu einer Dystopie), und wir können es uns nicht leisten, vor der harten Arbeit zurückzuschrecken, z.B. gemeinsam zu definieren, was eine “gute Zukunft” für uns, kollektiv und als Spezies, tatsächlich bedeutet und wie wir sie am besten gemeinsam gestalten können. So mühsam ein Konsensus über die Frage des “Guten” auch erscheinen mag, die Zukunft muss kollektiv geschaffen werden, oder es wird überhaupt keine geben – zumindest keine, die uns Menschen einbezieht (siehe die Analogien zu den NPTs unten).

Gerade jetzt, wo wir vielleicht endlich so etwas wie ein Licht am Ende des Pandemietunnels sehen, ist ein guter Zeitpunkt, um eine ehrliche und offene Diskussion über unsere gemeinsamen Ziele und unser Telos (d.h. den Zweck) zu beginnen, und über die Politik, die wir brauchen, um diese “gute Zukunft” zu schaffen. Eine Sache ist sicher: Die Doktrin des freien Marktes hat uns in letzter Zeit mindestens zweimal komplett im Stich gelassen (während der Finanzkrise 2007 und während der Covid-Krise), und die Rolle des Staates als Marktgestalter wird im kommenden Jahrzehnt zwangsläufig viel stärker in den Vordergrund treten. Die gute Zukunft wird wahrscheinlich nicht durch den guten alten Kapitalismus entstehen, und sie wird auch nicht durch Technologie eingeleitet werden. Vielmehr ist sie eine Frage der Ethik, der Werte und der Politik, die wir auf dieser Grundlage gestalten.

Zeit zur Rehumanisierung!

Jetzt ist es an der Zeit, über die “Zivilisierung” oder “Wiederhumanisierung” und ja, die Regulierung (aber nicht Strangulierung) der globalen Technologieriesen nachzudenken und zu handeln – denn in diesem Zeitalter des fortgeschrittenen exponentiellen Wandels könnten sich die erstaunlichen Durchbrüche von heute in nicht allzu ferner Zukunft als große Probleme herausstellen. Was bei “1” noch gut aussieht, ist vielleicht (oder sogar wahrscheinlich) nicht mehr in Ordnung, wenn wir “16” auf der Exponentialkurve erreichen (d.h. nach 5 Verdopplungen). Wir müssen also dringend viel weiter vorausschauen, denn wir bewegen uns mit Warp-Drive in die Zukunft. FORESIGHT ist jetzt einfach überlebenswichtig und nicht mehr nur “nice to have”. “Die Zukunft” wird zu einem steten Tagesordnungspunkt für jede Führungskraft und jeden Entscheidungsträger.

Hören wir also endlich auf zu fragen: “Was wird die Zukunft bringen?” – sie kann bald, im wahrsten Sinne des Wortes, fast alles bringen, was wir uns vorstellen können. Stattdessen müssen wir fragen: “Welche Zukunft WOLLEN wir“?

Die erstaunliche Leistung, nicht nur einen, sondern gleich mehrere wirksame Impfstoffe gegen SARS-CoV-2 zu entwickeln, ist ein gutes Beispiel für unseren beschleunigten exponentiellen Status. Was früher Jahrzehnte oder länger gedauert hat, dauert heute nur noch 12 Monate, vor allem dank der globalen Möglichkeiten von Cloud Computing und KI. Innerhalb eines Jahrzehnts wird dieser Entwicklungszyklus wahrscheinlich auf sechs Wochen oder weniger schrumpfen!

Diese Errungenschaften sollte jedoch nicht von der grundlegenden Wahrheit ablenken, dass Technologie immer einen doppelten Nutzen hat; sie kann gleichzeitig gut und nicht so gut sein: Sie ist “moralisch neutral, bis wir sie benutzen” (W. Gibson). “Zu viel des Guten” bzw. ‘too much of a good thing‘ beschreibt dieses Dilemma sehr gut: Etwas recht Nützliches kann schnell zu etwas zutiefst Schädlichem und zersetzendem für die Gesellschaft werden – wie jüngst bei den sozialen Medien zu sehen war, die unter exzessivem Goldrausch und völligem Mangel an Verantwortlichkeit leiden.

Deshalb denke ich, dass die Europäische Kommission mit ihren jüngsten Bemühungen zur Regulierung von KI und Technologie auf dem richtigen Weg ist. Ja, es ist kompliziert, es ist schmerzhaft und kann manchmal auch geradezu anmaßend sein – aber irgendwie müssen wir anfangen, über wirtschaftliche Faktoren und Wachstum um jeden Preis hinauszublicken und uns auf das zuzubewegen, was ich die vierfache Bottomline von “Menschen, Planet, Zweck und Wohlstand” / People Planet Purpose Prosperity nenne (in Erweiterung der Arbeit von Elkington und anderen zu ‘people planet profit' und der triple bottom line).

“Zu viel des Guten” – das kommt uns bekannt vor!

Es ist kein Zufall, dass die übermäßige Nutzung und Abhängigkeit von Internet und Online-Diensten oft als Sucht bezeichnet wird. Viele von uns nehmen in irgendeiner Form ‘Drogen', von Alkohol über Tabak bis hin zu mehr oder weniger kontrollierten Substanzen. Unsere Gesellschaft hat gelernt, mit diesen Süchten umzugehen, indem sie Gesetze, Vorschriften und eine Reihe von sozialen Verträgen erlassen hat, um ihre Reichweite und negativen Auswirkungen zu begrenzen. Technologie ist dem nicht unähnlich, denn auch sie ruiniert potenziell bei übermäßigem Gebrauch unser Leben. Viele Studien haben dokumentiert, dass Power-User von sozialen Netzwerken häufig ganz oben auf der Liste der Selbstmordgefährdeten stehen und dass FOMO (far of missing out) zu ernsthaften Angststörungen führen kann. Aber warten Sie nur, bis wir 5G und allgegenwärtige Virtual-Reality-Anwendungen und “Smart Glasses” zur Verfügung haben!

Es besteht die akute Gefahr, dass dieser rasante und sprunghafte technologische Fortschritt nicht klug genug gesteuert wird, bevor uns seine ständig wachsenden Möglichkeiten überwältigen und uns eine De-facto-Zukunft präsentieren, die die meisten von uns ihren Kindern oder Enkeln nicht wünschen würden. Wir brauchen daher eine Mischung aus neuen Normen und Gesellschaftsverträgen, Verantwortung und Rechenschaftspflicht in Wirtschaft und Industrie und echten Schutzmaßnahmen also Regulierung, Gesetze und Verträge. Unsere Antwort muss breit und flexibel sein, fair und demokratisch, aber dennoch sehr entschieden, wenn es um unsere Menschlichkeit geht.

Stellen Sie sich zum Beispiel vor, was bald möglich sein wird, wenn die meisten von uns ihre Gesundheitsdaten in der Cloud gespeichert haben und regelmäßig mit digitalen Assistenten und Chatbots interagieren, um z. B. Unterstützung bei psychischen Problemen zu erhalten. Die Zusammenführung von riesiger Datensätzen, die aus dem menschlichen Genom, dem Biom und aus Verhaltensbeobachtungen (z. B. bei der Nutzung eines Mobilgeräts oder einer Smartwatch oder beim Tragen eines VR-Sets) abgeleitet werden können, wird uns neue Werkzeuge bringen, mit denen wir degenerative Krankheiten erkennen und möglicherweise sogar Krebs im Voraus diagnostizieren können. Doch die Folgen von Datenschutzverletzungen in diesem Bereich könnten auch tausendmal schlimmer sein als die diversen heutigen Probleme z. B. wenn die Standortdaten von Menschen unrechtmäßig erfasst werden. Wie der Song schon sagt “You ain't seen nothing yet”.

Regulierung und die Herausforderung eines globalen Konsenses: die Analogie mit Nuklearwaffen

Ein nützliches Beispiel ist die Art und Weise, wie wir mit der Bedrohung durch die Weiterverbreitung von Atomwaffen umgegangen sind. Leider brauchte es zwei Atombomben und fast 25 Jahre harter Arbeit, bis der globale Atomwaffensperrvertrag 1970 in Kraft trat. Angesichts des schnellen und breiten technologischen Fortschritts haben wir heute nicht mehr den Luxus einer so langen Startbahn – und es ist wohl auch viel schwieriger, eine Atombombe zu bauen als Code zu schreiben. Oder – etwas düsterer betrachtet – könnte es sein, dass wir in einer nicht allzu fernen Zukunft zuerst auch erst einmal katastrophale Zwischenfälle erleben müssen, die durch übermäßiges Vertrauen auf untaugliche und unsichere “intelligente Maschinen” verursacht werden, oder dass wir mit einem noch größeren Zusammenbruch des Ökosystems aufgrund übereilter Experimente mit Geo-Engineering konfrontiert werden?

Auf lokaler, nationaler, regionaler und zwangsläufig auch auf globaler Ebene müssen wir uns deshalb dringend auf die gemeinsamen Grundlinien einigen und realistische Schwellenwerte für den “kleinsten gemeinsamen Nenner” festlegen, über die hinaus bestimmte technologische Anwendungen nicht verfolgt werden sollten, nur “weil wir es können” oder weil enorme wirtschaftliche Vorteile damit erzielt werden könnten. Ein gutes Beispiel für einen solchen erreichbaren Konsens ist das Verbot von autonomen Waffensystemen, die ohne menschliche Aufsicht töten, oder das Verbot der Verwendung von Gesichts- und neuerdings auch Affekterkennung für zweifelhafte kommerzielle Zwecke (auch das ist ein Thema, mit dem sich die EU-Kommission bereits beschäftigt).

Die einzige Frage, die wirklich zählt: Was für eine Welt wollen wir unseren Kindern hinterlassen?

Wir müssen begreifen, dass es in diesem kommenden Jahrzehnt nicht mehr darum gehen wird, welche Zukunft wir aufbauen können, sondern welche Zukunft wir designen wollen. Es wird nicht mehr nur um großartige Technik, ‘digitale Transformation' oder smarte Wirtschaft gehen, sondern um Werte, Ethik und Sinn (Purpose). Wissenschaftliche und technologische Begrenzungen werden weiterhin in rasantem Tempo wegfallen, während die ethischen und gesellschaftlichen Implikationen in den Mittelpunkt rücken werden. Wie E.O. Wilson bekanntlich sagte: “Das wahre Problem der Menschheit ist folgendes: wir haben paleolithische Emotionen, mittelalterliche Institutionen und gottähnliche Technologie”

Winston Churchill sagte einmal: “Man kann sich immer darauf verlassen, dass die Amerikaner das Richtige tun – nachdem sie alles andere versucht haben”, und ich passe dieses Zitat oft an “Menschen” statt Amerikaner zu lesen. Aber es wird unweigerlich Dinge geben, die niemals ausprobiert werden sollten, weil sie irreversible und existenzielle Folgen für uns und unseren Planeten haben könnten – und diese Liste wird jeden Tag länger. Angefangen mit dem Streben nach künstlicher allgemeiner Intelligenz (AGI), Geo-Engineering und menschlicher Genom-Editierung – all diese Technologien könnten potenziell “Himmlisch” sein, oder sie könnten Hölle bringen. Und wer wird die “Mission Control” für die Menschheit sein?

Insbesondere der gut dokumentierte Ansatz von den Silicon Valley Giganten, mit fast allem zu experimentieren und später um Erlaubnis zu fragen (“Move fast and break things“, in Zuckerbergs Parole vor dem Börsengang), wird uns auf einen sehr gefährlichen Weg führen. Diese Vorstellung mag zu Beginn der Exponentialkurve (wo sie fast genauso aussieht wie eine lineare Kurve) erträglich oder sogar aufregend gewesen sein, aber ansonsten ist dieses Paradigma entschieden ungeeignet, um “eine gute Zukunft” zu bringen. Um ‘danach schnell um Vergebung' zu bitten, funktioniert einfach nicht, wenn die Technologie schnell existenzielle Bedrohungen herbeiführen kann, die weit über die Herausforderung hinausgehen, der wir uns mit Atomwaffen bereits gegenübersehen.

Nehmen wir diese Idee, Menschen irgendwie “übermenschlich” zu machen, indem wir extreme Langlebigkeit anstreben oder unsere Gehirne mit dem Internet verbinden (ja, Elon Musk scheint sich anschicken zu wollen, führender Verfechter dieser Ideen zu werden). Ich befürchte oft dass wir Gefahr laufen, mit halb-garen Lösungen zu enden, die von gewinnorientierten Unternehmen eingeführt werden, während die Öffentlichkeit dann die Scherben aufsammeln kann, und die externen Effekte beheben muss – alles nur um des materiellen Fortschritts willen.

Wir befinden uns an einer Weggabelung: Die Zukunft ist unsere Wahl, durch Handeln oder durch Nichthandeln

Wir haben nur zehn kurze Jahre Zeit, um neue, globale (oder zumindest territoriale) Rahmenbedingungen und Regeln zu diskutieren, zu vereinbaren und zu implementieren, was die Steuerung und Kontrolle von exponentiellen Technologien angeht.

Wenn wir uns nicht wenigstens auf den kleinsten gemeinsamen Nenner einigen können (wie z.B. klare Verbote von tödlichen autonomen Waffensystemen oder Verbote des Einsatzes von Gentechnik am Menschen für militärische Zwecke), sage ich voraus, dass sich die externen Effekte des ungehemmten und unkontrollierten technologischen Wachstums von KI, menschlicher Genom-Editierung und Geo-Engineering als ebenso schädlich erweisen werden wie die, die durch das nahezu ungebremste Wachstum der fossilen Wirtschaft entstanden sind. Statt des Klimawandels wird es der “menschliche Wandel” sein, der uns vor sehr harte Herausforderungen stellen wird, wenn wir hier nicht etwas mehr “Vorsichtsdenken” walten lassen.

In Zukunft sollte es deswegen z.B. niemandem mehr erlaubt sein, die negativen externen Effekte seines Geschäfts auszulagern, sei es in den Bereichen Energie, Werbung, Suche, soziale Medien, Cloud Computing, IoT, KI oder Virtual Reality.

Wenn ein Unternehmen wie Google von Alphabet ein ganzes Stadtviertel in Toronto in sein Smart-City-Labor (Side Walks Lab) verwandeln will, muss m.E. das initiierende Unternehmen – und nicht die Stadtverwaltung, der Statt oder die Zivilgesellschaft – für die daraus resultierenden gesellschaftlichen Veränderungen, die die allgegenwärtige Konnektivität und das Tracking mit sich bringen, zur Verantwortung gezogen werden. Unternehmen wie Google müssen erkennen, dass sie in dieser exponentiellen Ära (d.h. “jenseits des Drehpunkts”) tatsächlich dafür verantwortlich sind, was sie erfinden und wie sie es ausrollen. Jede technologische Frage ist jetzt auch eine ethische Frage, und Erfolg in der Technologie ist nicht mehr nur “starke Wissenschaft, erstaunliche Technik und skalierbare Geschäftsmodelle” (und das war es vielleicht eigentlich nie).

Stattdessen muss die Verantwortung für die Bewältigung potenziell schwerwiegender (und zunehmend existenzieller) Nachteile von Anfang an in jedes Geschäftsmodell einfließen, und alle möglichen Nebenwirkungen müssen während des gesamten Geschäftsentwicklungsprozesses und aller nachfolgenden Einführungsphasen berücksichtigt werden. Wir müssen uns von der Standard-Doktrin “Erst das Essen, dann die Moral” des Silicon Valley (oder auch der chinesischen Pendants) verabschieden. Ganzheitliche Ansätze (d.h. Modelle, die der Gesellschaft, der Industrie, der Wirtschaft und der Menschheit insgesamt zugutekommen) müssen die “move fast and break things”- Haltung ersetzen, und die Stakeholder-Logik muss das Shareholder-Primat ersetzen (*hier können Sie Paul Polman, den ehemaligen CEO von Unilever, darüber sprechen sehen)

3 von meinen 6 Zukunftsprinzipien

Innerhalb der nächsten fünf Jahre werden meiner Meinung nach neue Aktienmärkte entstehen (wie z.B. die LTSE in San Francisco), an denen Unternehmen notiert sein werden, die unter der Prämisse “People, Planet, Purpose and Prosperity” arbeiten. EUROPA sollte diese Chance ergreifen und eine Führungsrolle übernehmen!

Nennen Sie mich einen Optimisten oder Utopisten, aber ich bin überzeugt, dass wir immer noch eine “gute Zukunft” für die gesamte Menschheit sowie für unseren Planeten definieren und gestalten können.

Here are some suggestions to guide this debate:

- Die ethischen Fragen der Exponentialtechnologien müssen als ebenso wichtig erachtet werden wie die wirtschaftlichen Gewinne, die sie bringen können. Technologie ist nicht die Antwort auf jedes Problem, und wir wären schlecht beraten, wenn wir von der Technologie die “Lösung für alles” erwarteten. Wenn es eine Sache gibt, die ich in meinen 20 Jahren als Futurist gelernt habe, dann ist es diese: Technologie wird niemals soziale, kulturelle oder menschliche Probleme wie (Un-)Gleichheit oder Ungerechtigkeit lösen. Im Gegenteil, sie verschlimmert dies Probleme oft, weil Technologie die Effizienz ohne Rücksicht auf moralische Konsequenzen vorantreibt. Facebook ist das beste Beispiel für diese Problematik: ein wirklich mächtiges Konzept, sehr klug konstruiert, unglaublich gut funktionierend (genau wie entworfen !) – und doch zutiefst zersetzend für unsere Gesellschaft (sehen Sie sich meine Vorträge zu diesem Thema an, hier). Tim Cook, der CEO von Apple, bringt es auf den Punkt, wenn er sagt: “Technologie kann großartige Dinge tun, aber sie will keine großartigen Dinge tun. Sie will gar nichts.” Das “Wollen” ist unser Job, und wir sollten uns nicht vor dieser Verantwortung drücken, nur weil sie mühsam ist oder die Monetarisierung verlangsamen könnte.

- Der Mensch muss in-the-loop (HITL) bleiben: Für die absehbare Zukunft und bis wir viel besser darin sind, uns selbst zu verstehen (und damit meinen ich nicht nur unser Gehirn) und in der Lage sind, die Technologien und Maschinen zu kontrollieren, die potenziell “wie wir sein könnten” (aka AGI oder ASI), glaube ich fest daran, dass wir den HITL haben müssen, auch wenn es weniger effizient, langsamer oder kostspieliger ist. Andernfalls sind wir vielleicht viel schneller auf dem Weg zur Entmenschlichung, als wir denken: Pro-Aktion und Precaution müssen sorgfältig abgewogen werden und ständig in Balance sein.

- Wir müssen das kurzfristige Denken verbannen und uns angewöhnen, sowohl eine exponentielle als auch eine langfristige Sichtweise einzunehmen – und dabei trotzdem die Tatsache respektieren, dass der Mensch organisch ist (d. h. das Gegenteil von exponentiell). Wie oben erwähnt, überschreiten wir gerade die magische Grenze, an der das Tempo der Veränderung in die Höhe schießt: 1-2-3 mag wie 1-2-4 aussehen, aber der Sprung von 4 auf 8 auf 16 ist etwas ganz anderes als der von 3 auf 4 auf 5. Wir müssen lernen und üben, linear zu leben, aber exponentiell zu denken; ein Bein in der Gegenwart und ein Bein in der Zukunft.

- Wir brauchen neue “Nichtverbreitungs-Verträge”: Künstliche allgemeine Intelligenz (AGI), Geo-Engineering oder menschliches Genom-Editing sind sowohl magische Möglichkeiten als auch erhebliche existenzielle Bedrohungen (genau wie die Atomkraft, würden einige Kollegen argumentieren), aber wir werden wahrscheinlich nicht den Luxus haben, uns in AGI auszutoben und uns dann von einem Misserfolg zu erholen. Eine “Intelligenzexplosion” in der KI könnte durchaus ein irreversibles Ereignis sein, ebenso wie die Veränderung des menschlichen Genoms in der ‘germ-line'. Wir brauchen daher dringend zukunftsweisende, verbindliche und kollektive Standards, beginnend mit einem internationalen Memorandum zu AGI.

- Ich habe in den letzten fünf Jahren viel über die Notwendigkeit eines “Digitalen Ethikrates” gesprochen, beginnend mit meinem 2016 erschienenen Buch “Technology vs Humanity”. Viele Länder, Staaten und Städte haben in letzter Zeit begonnen, ähnliche Gremien zu gründen, wie zum Beispiel das European Artificial Intelligence Board der EU. Wir brauchen mehr davon, regional, national, international und global!

Hier stehen wir also im Jahr 2021 und stehen an dieser schicksalhaften und auch sehr hoffnungsvollen Weggabelung. Es liegt an uns allen, den richtigen Weg zu wählen und mit dem Aufbau der “guten Zukunft” zu beginnen!

Es ist noch nicht zu spät – haben Sie Hoffnung, haben Sie Mut und streben Sie nach Weisheit!