Por qué debemos actuar ahora para que el progreso tecnológico exponencial siga siendo beneficioso para la humanidad y el planeta.

Gerd Leonhard, futurista y humanista. Zúrich, Suiza, 17 de mayo de 2021. Publicado también en Mundo cognitivo. Versión en portugués aquí. Versión alemana aquí. Versión española aquí. Relacionado: lea mi nuevo documento de política europea.

ACTUALIZACIÓN 1 de diciembre de 2021: Lea mi último post sobre el Metaverso: La Gran Reducción

No cabe duda de que la tecnología nos ha beneficiado. Los sistemas de inteligencia artificial son capaces de detectar algunas formas de cáncer de piel con mayor precisión que los médicos. Los robots realizan ecografías y operaciones quirúrgicas, a veces sin apenas intervención humana. Los pilotos automáticos vuelan y aterrizan aviones en las condiciones más adversas y pronto podrán dirigir taxis aéreos personales. Los sensores recopilan datos en tiempo real de la maquinaria y sus "gemelos digitales" para predecir fallos inminentes o avisar de reparaciones cruciales. Impresoras 3D son capaces de escupir piezas de repuesto, lo que mejora las opciones de mantenimiento en lugares remotos.

Sin embargo, a medida que la tecnología y Sistemas de IA en particular, son cada vez más potentes, también se hace patente el lado negativo de la aceleración exponencial del progreso tecnológico. Inspirándonos en Marshall McLuhan (¡hace 57 años!), cada vez que ampliamos nuestras capacidades, también amputamos otras. Hoy en día, las redes sociales prometen "ampliarnos" al permitirnos a todos compartir nuestros pensamientos en línea, pero también nos "amputan" al convertirnos en blancos fáciles del rastreo y la manipulación. Ganamos en alcance, pero perdemos en privacidad.

El impacto del cambio exponencial es increíblemente difícil de imaginar

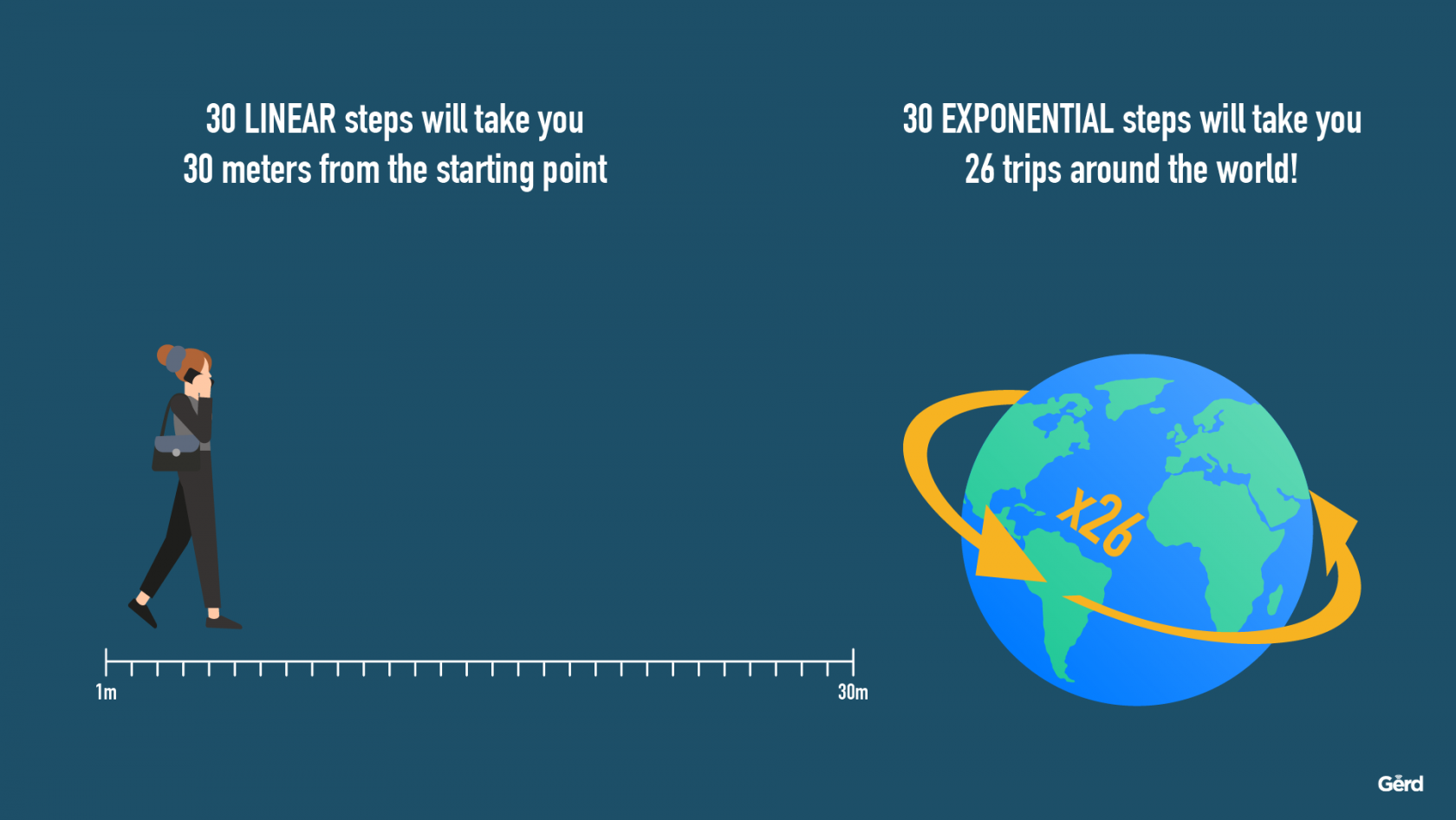

Debemos tener en cuenta que, aunque el progreso tecnológico actual parece a menudo muy impresionante y útil, en su mayor parte inofensivo y fácilmente manejable, sería muy insensato suponer que esto seguirá igual en un futuro próximo, ya que estamos saltando literalmente por la curva exponencial de 4 a 8 a 16 y así sucesivamente. 30 pasos lineales pueden llevarme a cruzar la calle, 30 pasos exponenciales equivalen a 26 viajes alrededor del globo. El alcance de la magnitud es totalmente diferente y lo que puede tener trabajadas antes del punto de giro pueden resultar desastrosas más adelante.

Aquí y ahora nos encontramos en el punto de despegue de muchas de las ciencias y tecnologías fundacionales del siglo XXI, desde la inteligencia artificial y el aprendizaje profundo hasta la edición del genoma humano, pasando por la geoingeniería, la longevidad y la mejora humana: todo nuestro marco está a punto de cambiar...". no sólo la imagen!

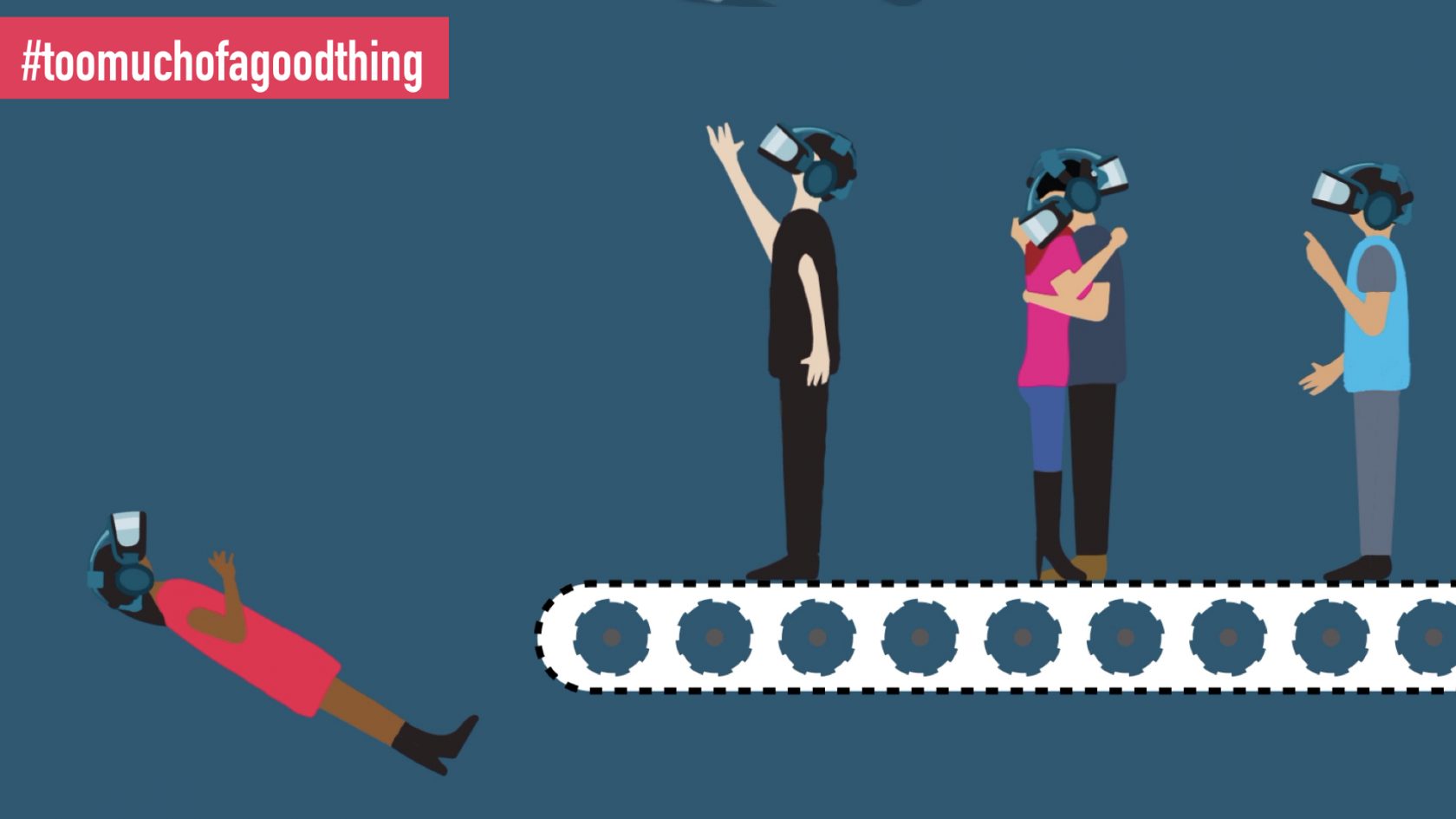

Durante la década siguiente, todos y cada uno de los ámbitos mencionados anteriormente (lo que yo suelo llamar el Game-Changers) nos depara más cambios que los que presenciamos en todo el siglo anterior, en total. La ciencia ficción se convierte cada vez más en ciencia real - y puesto que los seres humanos son biológicos (por ahora) y no progresan exponencialmente, a menudo nos cuesta mucho entender hacia dónde va todo esto. Lo que hoy puede ser realmente asombroso, mágico y "bueno" para nosotros, pronto puede convertirse en "demasiado de algo bueno", y pasar de ser una herramienta a ser el propósito, de ser un enviado de Dios a ser una máquina del juicio final.

Ya sea mejorando a los humanos, diseñando quimeras o robots que van a la guerra: ¿Qué ocurrirá durante los próximos 10 años barrerá con la mayoría de nuestras nociones sobre el progreso gradual y dará un vuelco a nuestras opiniones sobre cómo la innovación tecnológica suele fomentar el bien común, e incluso puede que lo haga inadvertidamente.

Definir "el buen futuro

En mi opinión, lo que recientemente he empezado a llamar "el buen futuro"(es decir, una utopía o, mejor aún, una protopia en lugar de una distopía), y no podemos permitirnos el lujo de rehuir la ardua tarea de definir colectivamente lo que significa un "buen futuro" para nosotros, colectivamente y como especie, y cuál es la mejor manera de forjarlo juntos. Por arduo que pueda parecer llegar a un consenso sobre la cuestión del "bien", el futuro debe crearse colectivamente o no habrá ninguno, al menos no uno que nos incluya a los humanos (véanse las analogías entre el tratado nuclear y el TNP más adelante).

Ahora que se vislumbra una luz al final del túnel de la pandemia, es un buen momento para entablar un debate sincero y abierto sobre nuestros objetivos comunes y nuestras prioridades. telos (es decir, el propósito), y sobre las políticas que necesitaremos para crear eseBuen futuro'. Una cosa es cierta: La doctrina del libre mercado nos ha fallado recientemente al menos en dos ocasiones (durante la crisis financiera de 2007 y durante la crisis de Covid), y el papel del gobierno como regulador del mercado está destinado a ser mucho más prominente en la próxima década. No es probable que el Buen Futuro surja del capitalismo a la antigua usanza, ni tampoco de la tecnología. Se trata más bien de una cuestión de ética, de valores y de las políticas que elaboremos basándonos en ellos.

Hora de rehumanizarse

Ahora es el momento de pensar y actuar para "civilizar" o "rehumanizar"Y sí, regulando (pero no estrangulando) a los gigantes mundiales de la tecnología, porque en esta era de cambios exponenciales avanzados, los asombrosos avances de hoy pueden convertirse en graves problemas en un futuro no muy lejano. Lo que parece estar bien en "1" puede dejar de estarlo cuando lleguemos a "16" en la curva exponencial (es decir, después de 5 duplicaciones). Necesitamos urgentemente mirar mucho más allá, ya que avanzamos hacia el futuro a velocidad de vértigo. La prospectiva es ahora una misión crítica y ya no es "agradable de tener". El futuro" se está convirtiendo en un tema de la agenda diaria de todos los dirigentes y funcionarios públicos.

Así que dejemos de preguntarnos "qué nos deparará el futuro", que pronto puede depararnos, literalmente, casi cualquier cosa que podamos imaginar. Mejor, debemos preguntarnos: "¿qué tipo de futuro QUEREMOS??

La asombrosa hazaña de desarrollar no sólo una sino varias vacunas eficaces contra el SRAS-CoV-2 es un ejemplo de nuestra acelerada situación exponencial. Lo que antes llevaba una década o más, ahora apenas lleva 12 meses, gracias en gran parte a las capacidades globales de la computación en nube y la IA. Dentro de una década, es probable que ese ciclo de desarrollo se reduzca a seis semanas o menos. Sólo imagine.

Sin embargo, este logro no debe distraer de la verdad básica de que la tecnología siempre tiene un doble uso; puede ser buena y no tan buena al mismo tiempo: Es "moralmente neutra hasta que la utilizamos" (W. Gibson). "Demasiado de algo bueno"describe muy bien este enigma: algo bastante útil puede convertirse rápidamente en algo profundamente perjudicial y corrosivo para la sociedad, como se ha puesto de manifiesto recientemente con las redes sociales, que sufren una obsesión excesiva por la monetización y una absoluta falta de responsabilidad.

Por eso creo que la Comisión Europea va por buen camino con su reciente Esfuerzos para regular la IA y la tecnología. Sí, es complicado, es doloroso y a veces puede resultar agobiante, pero de alguna manera debemos empezar a mirar más allá de los factores económicos y del crecimiento a toda costa, y avanzar hacia lo que he venido llamando el cuádruple balance final de "personas, planeta, propósito y prosperidad"(ampliando el trabajo realizado por Elkington y otros sobre la triple cuenta de resultados).

“Demasiado de algo bueno", ¿le suena?

No es casualidad que el uso excesivo y la dependencia de dispositivos y servicios en línea se consideren a menudo una adicción. Muchos de nosotros consumimos drogas de alguna forma, desde alcohol y tabaco hasta incluso sustancias controladas. Las sociedades han aprendido a lidiar con esas adicciones mediante leyes, reglamentos y una serie de contratos sociales diseñados para limitar su alcance e impacto negativo. La tecnología no es diferente, ya que el uso excesivo o la sobreexposición también arruinan vidas. Muchos estudios han documentado que los usuarios avanzados de las redes sociales suelen encabezar las listas de suicidasy que el FOMO (far of missing out) puede provocar graves trastornos de ansiedad. Pero espere a que tengamos 5G y aplicaciones omnipresentes de realidad virtual y "gafas inteligentes".

Existe el peligro palpable de que este rápido y vertiginoso progreso tecnológico no se gobierne con sensatez antes de que sus capacidades en constante expansión nos desborden y nos presenten un futuro de facto que la mayoría de nosotros no desearía para sus hijos. Por lo tanto, necesitamos una combinación de "nuevas normas" y contratos sociales, responsabilidad y rendición de cuentas demostradas en las empresas y la industria, y salvaguardias reales como reglamentos, leyes y tratados. Nuestra respuesta debe ser amplia y flexible, justa y democrática, pero decisiva a la hora de actuar por el lado de la precaución.

Imagínese, por ejemplo, lo que pronto será posible una vez que la mayoría de nosotros tengamos nuestra datos sanitarios almacenados en la nube e interactúan habitualmente con asistentes digitales y chatbots para cuestiones como la salud mental. La puesta en común de conjuntos de datos masivos derivados del genoma humano, el bioma y las observaciones del comportamiento (por ejemplo, cuando se utiliza un dispositivo móvil o un reloj inteligente o cuando se lleva un equipo de realidad virtual) puede proporcionarnos herramientas para detectar enfermedades degenerativas y, posiblemente, incluso... prediagnosticar el cáncer. Sin embargo, las consecuencias de las violaciones de la privacidad en este ámbito también podrían ser mil veces peores que las trampas actuales, por ejemplo, cuando se captan ilícitamente los datos de localización de las personas. Como dice la canción: "Aún no has visto nada".

La regulación y el reto del consenso mundial: la analogía nuclear

Un ejemplo útil es la forma en que nos enfrentamos a la amenaza de la proliferación nuclear. Desgraciadamente, se necesitaron dos bombas nucleares y casi 25 años de duro trabajo antes de que la comunidad internacional se diera cuenta de que la proliferación nuclear era un problema mundial. Los TNP entraron en vigor en 1970. Hoy en día, dado lo rápido y amplio que avanza la tecnología, ya no podremos permitirnos el lujo de una pista tan larga, y es mucho más difícil construir una bomba nuclear que escribir código. O, desde un punto de vista más sombrío, ¿podría ser que en un futuro no muy lejano tengamos que experimentar primero incidentes catastróficos causados por confiar demasiado en "máquinas inteligentes" no aptas e inseguras, o enfrentarnos a un colapso aún mayor del ecosistema debido a experimentos precipitados con geoingeniería?

A escala local, nacional, regional e inevitablemente mundial, tenemos que ponernos de acuerdo sobre lo que podemos consensuar y establecer umbrales realistas de "mínimo común denominador" más allá de los cuales no se puedan llevar a cabo determinadas aplicaciones tecnológicas sólo "porque podemos" o porque se puedan obtener enormes beneficios económicos. Un ejemplo de consenso alcanzable es un prohibición de los sistemas de armas autónomas que matan sin supervisión humana, o prohibir el uso del reconocimiento facial y, más recientemente, del reconocimiento de afectos con fines comerciales dudosos. Es otra cuestión que la Comisión Europea ha empezado a abordar.

La única pregunta que realmente importa: ¿Qué clase de mundo queremos dejar a nuestros hijos?

Debemos darnos cuenta de que en esta próxima década ya no se tratará del futuro que puede construir, pero qué futuro nos quieren construya. Ya no se tratará sólo de ingeniería o de economía inteligente, sino de valores, ética y objetivos. Las limitaciones científicas y tecnológicas seguirán desapareciendo a gran velocidad, mientras que las implicaciones éticas y sociales se convertirán en el verdadero centro de atención. Como dijo E.O. Wilson: "El verdadero problema de la humanidad es el siguiente: tenemos emociones paleolíticas; instituciones medievales; y tecnología divina...".“

Además, Winston Churchill proclamó: "Siempre se puede contar con que los estadounidenses harán lo correcto, después de haber intentado todo lo demás.A menudo adapto esta cita para que diga "humanos" en lugar de estadounidenses. Pero inevitablemente habrá cosas que no deban probarse nunca porque pueden tener consecuencias irreversibles y existenciales para los seres humanos y nuestro planeta, y eso la lista se alarga cada día. Empezando por la búsqueda de la inteligencia artificial general, la geoingeniería y la edición del genoma humano - todas estas tecnologías podrían ser potencialmente el cielo, o podrían ser el infierno. Y quién será "control de misión" para la humanidad?

En particular, el bien documentado enfoque de Silicon Valley de experimentar con casi cualquier cosa y pedir permiso más tarde ("Muévete rápido y rompe cosas", en El lenguaje de Zuckerberg antes de la OPV) nos llevará por un camino muy peligroso. Esta noción puede haber sido tolerable o incluso emocionante al principio de la curva exponencial (donde parece casi igual que una curva lineal), pero de cara al futuro este paradigma es decididamente inadecuado para ayudar a conseguir "el buen futuro". Pedir perdón simplemente no funciona cuando la tecnología puede traer rápidamente amenazas existenciales que pueden estar mucho más allá del desafío al que nos enfrentamos con las armas nucleares.

Por ejemplo, la idea de convertir de algún modo a los humanos en "superhumanos" persiguiendo la longevidad extrema o conectar nuestro cerebro a internet (sí, Elon Musk parece estar clamando por convertirse en el principal proveedor de estas ideas). Me temo que corremos el riesgo de acabar con soluciones a medias introducidas por empresas con ánimo de lucro mientras el público tiene que recoger los pedazos y arreglar las externalidades, todo en aras del progreso.

Nos encontramos en una encrucijada: El futuro es nuestra elección, por acción o por inacción

El tiempo es esencial. Tenemos diez cortos años debatir, acordar y aplicar nuevos marcos y normas globales (o al menos territoriales) en lo que respecta al gobierno de las tecnologías exponenciales.

Si no logramos ponernos de acuerdo al menos en los denominadores comunes más bajos (como prohibiciones claras de los sistemas de armas autónomas letales, o prohibiciones de utilizar la ingeniería genética de seres humanos con fines militares) me preocupa que la externalidades del crecimiento tecnológico incontrolado y sin supervisión en la IA, la edición del genoma humano y la geoingeniería resultarán ser tan dañinos como los creados por el crecimiento casi sin restricciones de la economía de los combustibles fósiles. En lugar del cambio climático, será el "cambio humano" el que nos plantee retos muy perversos si no aplicamos algunas medidas más. pensamiento preventivo aquí.

En el futuro, no se debería permitir a nadie externalizar las externalidades negativas de su negocio, ya sea en la energía, la publicidad, las búsquedas, las redes sociales, la computación en la nube, el Internet de las cosas, la inteligencia artificial o la realidad virtual.

Cuando una empresa como Google, de Alphabet, quiere convertir todo un barrio de Toronto en su laboratorio de ciudades inteligentes (Laboratorio de paseos laterales), es la empresa iniciadora, y no la comunidad y la sociedad civil, la que debe responder de los cambios sociales que la conectividad y el rastreo omnipresentes provocan, tanto buenos como malos. Empresas como Google deben darse cuenta de que en esta era exponencial (es decir, "más allá de el punto de giro") son realmente responsables de lo que inventan y de cómo lo ponen en marcha. Cada cuestión tecnológica es ahora también una cuestión ética, y el éxito en la tecnología ya no es sólo "una gran ciencia, una ingeniería asombrosa y modelos de negocio escalables" (y quizás nunca lo fue).

En lugar de ello, las responsabilidades de hacer frente a situaciones potencialmente graves (y cada vez más existencial) en cada modelo de negocio, desde el principio, y hay que tener en cuenta todos los posibles efectos secundarios durante todo el proceso de diseño del negocio y todas las fases posteriores de despliegue. Tenemos que descartar el concepto por defecto deprimero la cena, luego la moral' - doctrina de Silicon Valley o sus equivalentes chinos. Los enfoques holísticos (es decir, los modelos que benefician a la sociedad, la industria, las empresas y la humanidad en general) deben sustituir a "moverse rápido y romper cosasy lógica de las partes interesadas debe sustituir a la primacía del accionista (*vea a Paul Polman, antiguo CEO de Unilever, hablar de esto, aquí)

En los próximos cinco años, creo que veremos surgir nuevos mercados bursátiles (como el aún incipiente LTSE en San Francisco) en el que figurarán empresas que operan bajo la premisa de "Personas, Planeta, Propósito y Prosperidad". EUROPA debe aprovechar esta oportunidad ¡y toma la delantera!

Llámenme optimista o utópico, pero estoy convencido de que aún podemos definir y dar forma a un "buen futuro" para toda la humanidad, así como para nuestro planeta.

He aquí algunas sugerencias para orientar este debate:

- Las cuestiones éticas de las tecnologías exponenciales deben considerarse tan importantes como los beneficios económicos que puedan generar. La tecnología no es la respuesta a cada problema, y haríamos mal en buscar en la tecnología la "solución a todo". Si hay algo que he aprendido en mis 20 años como futurólogo es lo siguiente: La tecnología no resolverá problemas sociales, culturales o humanos como la (in)igualdad o la injusticia. Al contrario, a menudo empeora las cosas porque la tecnología impulsa la eficiencia sin tener en cuenta sus consecuencias morales. Facebook es el mejor ejemplo de este efecto: un concepto realmente poderoso, ingeniosamente diseñado, que funciona increíblemente bien (tal y como fue diseñado) y, sin embargo, profundamente corrosivo para nuestra sociedad (vea mis charlas sobre este tema), aquí). El consejero delegado de Apple, Tim Cook, da en el clavo cuando dice: "La tecnología puede hacer grandes cosas, pero no quiere hacer grandes cosas. No quiere nada." El "querer" es nuestro trabajo, y no debemos eludir esa responsabilidad sólo porque sea tedioso o pueda ralentizar la monetización.

- Los humanos deben permanecer en el bucle (HITL): En el futuro inmediato y hasta que estemos mucho más avanzados en la comprensión nosotros mismos (y no sólo nuestros cerebros) y capaz de controlar las tecnologías que potencialmente podrían "ser como nosotros" (alias AGI o ASI), creo firmemente que necesitamos mantener a los humanos en el bucle, aunque sea menos eficiente, más lento o más costoso. De lo contrario, puede que nos encaminemos hacia la deshumanización mucho más rápido de lo que pensamos. Pro-acción y pre-caución deben considerarse cuidadosamente y equilibrarse constantemente.

- Tenemos que prohibir el pensamiento a corto plazo y acostumbrarse a adoptar una visión tanto exponencial como a largo plazo, respetando al mismo tiempo el hecho de que los seres humanos son orgánicos (es decir, lo contrario de exponencial). Como ya se ha dicho, justo ahora estamos cruzando esa línea mágica en la que el ritmo del cambio se dispara: 1-2-3 puede parecerse mucho a 1-2-4, pero saltar de 4 a 8 y a 16 es muy diferente de pasar de 3 a 4 y a 5. Debemos aprender y practicar cómo vivir linealmente pero imaginar exponencialmente; una pierna en el presente y otra en el futuro.

- Necesitamos nuevos "tratados de no proliferación". La inteligencia general artificial (AGI), la geoingeniería o la edición del genoma humano son tanto oportunidades mágicas como importantes amenazas existenciales (al igual que la energía nuclear, argumentarían algunos), pero probablemente no tendremos la lujo de incursionar en AGI y recuperarse del fracaso. Un "explosión de inteligencia"en la IA bien podría ser un acontecimiento irreversible, al igual que las modificaciones del genoma humano en la línea germinal. Por lo tanto, necesitaremos normas de futuro, vinculantes y colectivas, empezando por un memorándum internacional sobre AGI.

- He estado hablando de la necesidad de un "Consejo de Ética Digital". mucho durante los últimos cinco años, empezando por mi libro de 2016 "Technology vs Humanity". Muchos países, estados y ciudades han empezado a crear organismos similares últimamente, como el Consejo Europeo de Inteligencia Artificial de la UE. ¡Necesitamos más de estos, a nivel regional, nacional, internacional y mundial!

Así que aquí estamos en 2021, ante esta fatídica y también muy esperanzadora bifurcación del camino. De todos nosotros depende elegir el camino correcto y empezar a construir el "buen futuro".

No es demasiado tarde: ¡ten esperanza, ten valor y persigue la sabiduría!